Dans un ecosysteme technologique ou l’intelligence artificielle generative ne cesse de transformer les pratiques professionnelles, Google lance Gemini CLI, un agent IA open source qui s’integre directement dans votre terminal. Cette outil novateur permet aux developpeurs, administrateurs systemes et professionnels de l’IT d’exploiter la puissance du modele Gemini sans quitter leur

environnement de travail habituel. Fini les aller-retours entre le navigateur et l’editeur de code :

Gemini CLI vous offre un acces immediat a une IA de pointe, capable de comprendre le contexte de vos projets, d’executer des commandes shell, de lire et modifier vos fichiers, et meme de rechercher des informations en temps reel sur le web.

Ce guide complet vous accompagne pas a pas dans la prise en main de Gemini CLI. Nous aborderons l’installation, les commandes essentielles, la configuration avancee, le deploiement d’applications, l’automatisation via le protocole MCP, et bien plus encore. Que vous soyez un developpeur chevronne ou un curieux souhaitant optimiser sa productivite, cet article est fait pour vous. Pour approfondir votre comprehension de l’IA dans le monde professionnel, nous vous recommandons de consulter notre article sur l’intelligence artificielle en entreprise, qui presente les enjeux strategiques de ces technologies pour les organisations francophones.

Gemini CLI se distingue des solutions concurrentes par son model gratuit extremement genereux :

avec un simple compte Google personnel, vous beneficiez de 60 requetes par minute et jusqu’a 1 000 requetes par jour, un seuil bien superieur a celui propose par de nombreux outils similaires.

Ajoutez a cela une fenetre de contexte d’un million de tokens, le support natif du protocole MCP (Model Context Protocol), et une communaute open source en pleine croissance, et vous comprenez pourquoi Gemini CLI s’impose comme un outil incontournable pour tout professionnel de la tech en 2026.

1 Qu’est-ce que Gemini CLI ?

1.1 Présentation générale

Gemini CLI est un agent IA open source developpe par Google qui fonctionne directement dans votre terminal. Contrairement aux interfaces web comme ChatGPT ou Claude.ai, Gemini CLI s’execute en ligne de commande, offrant ainsi une integration naturelle avec les workflows de developpement existants. L’outil est construit autour du modele Gemini 3, la derniere generation de modeles de langage de Google, capable de raisonnement avance, de comprehension multimodale et de generation de code de haute qualite. Son architecture modulaire permet de l’etendre via des serveurs MCP, des commandes personnalisees et des extensions officielles.

Le positionnement de Gemini CLI est clair : devenir le compagnon IA de reference pour les developpeurs travaillant en ligne de commande. Il rejoint une famille d’outils similaires comme Aider, Cursor Agent ou GitHub Copilot CLI, mais se differencie par son acces gratuit exceptionnel, son integration profonde avec l’ecosysteme Google (Cloud Run, Firebase, Google Workspace), et sa capacite a fonctionner entierement en local grace au mode sandbox Docker. Pour ceux qui souhaitent explorer les alternatives dans le domaine de l’IA, notre guide sur l’IA et le marketing digital offre un panorama complet des outils disponibles sur le marche.

1.2 Fonctionnalites cles

Les fonctionnalites de Gemini CLI couvrent un spectre large qui va bien au-dela du simple chatbot en terminal. Voici un apercu des capacites principales qui font de cet outil un allie de choix pour les professionnels :

| Fonctionnalité | Description | Cas d’usage |

|---|---|---|

| Modelés Gemini 3 | Acces aux modeles Pro, Flash et Flash-Lite avec raisonnement avance et fenetre de contexte de 1M tokens | Analyse de gros codebases, generation de documentation technique |

| Google Search Grounding | Recherche web en temps reel integree directement dans les reponses de l’IA | Verification de documentation, recherche de solutions a jour |

| Operations fichier | Lecture, ecriture et modification de fichiers directement depuis le terminal | Refactoring de code, generation de fichiers de configuration |

| Commandes Shell | Execution de commandes systeme avec approbation ou mode YOLO automatique | Deployement, tests, gestion de processus |

| Protocole MCP | Integration de serveurs externes (bases de donnees, API, services cloud) | Connectivite avec Firebase, GitHub, bases de donnees SQL |

| Mode headless | Execution non-interactive pour scripts et pipelines CI/CD | Automatisation de revues de code, generation de rapports |

| Sandbox Docker | Execution isolee dans un conteneur pour la securite | Tests de commandes potentiellement dangereuses en toute securite |

| GEMINI.md | Fichiers de contexte project pour instructions persistantes | Conventions de code, guidelines de projet, preferences d’equipe |

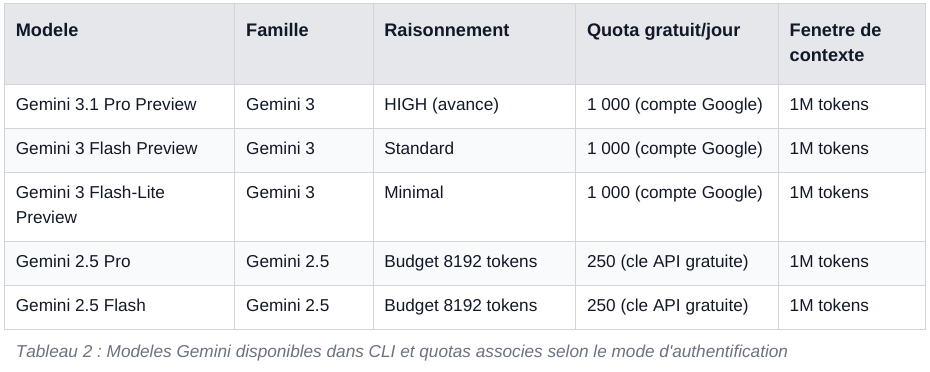

1.3 Modeles disponibles et quota gratuit

L’une des forces majeures de Gemini CLI reside dans la variete des modeles accessibles et dans la generosite du forfait gratuit. Google met a disposition plusieurs versions de son modele Gemini, chacune adaptee a des besoins specifiques. Le modele Gemini 3.1 Pro offre le raisonnement le plus avance avec un niveau de reflexion (thinking level) configure sur HIGH, ideal pour les taches complexes comme l’architecture logicielle ou l’analyse de code. Le modele Gemini 3 Flash privilegie la rapidite d’execution pour les taches quotidiennes comme l’autocompletion ou les corrections simples. Enfin, le modele Flash-Lite offre un equilibre entre performance et economie de ressources pour les operations de routine.

Il est important de noter que le mode d’authentification influence directement le quota disponible. Un simple compte Google personnel offre 1 000 requetes par jour avec un debit de 60 requetes par minute, ce qui est amplement suffisant pour une utilisation intensive. Les abonnes Google AI Pro beneficient de 1 500 requetes quotidiennes, et les utilisateurs AI Ultra atteignent 2 000 requetes.

Pour les environnements d’entreprise, Vertex AI Express offre 90 jours gratuits avant facturation, tandis que Code Assist Enterprise propose jusqu’a 2 000 requetes par jour. Cette flexibilite tarifaire rend Gemini CLI accessible aussi bien aux developpeurs independents qu’aux grandes organisations. Pour mieux comprendre comment l’IA transforme les entreprises, consultez notre article dedie a l’intelligence artificielle en entreprise.

2 Installation de Gemini CLI

2.1 Prérequis système

Avant d’installer Gemini CLI, assurez-vous que votre environnement repond aux prerequis minimum. L’outil requiert Node.js version 20.0.0 ou superieure, ce qui signifie que la plupart des configurations de developpement modernes sont compatibles. Cote systeme d’exploitation, Gemini CLI supporte macOS 15 et versions posterieures, Windows 11 (24H2 minimum), ainsi que Ubuntu 20.04 et distributions Linux equivalentes. Pour une utilisation confortable, 4 Go de RAM suffisent, mais Google recommande 16 Go ou plus pour les scenarios avances impliquant l’analyse de gros projets ou l’execution simultanee de plusieurs serveurs MCP.

Il est interessant de noter que Gemini CLI est pre-installe sur Google Cloud Shell et Google Cloud Workstations, ce qui permet de l’utiliser immediatement sans aucune installation si vous travaillez deja dans l’ecosysteme Google Cloud. Les shells supportes incluent Bash, Zsh et PowerShell, couvrant ainsi la quasi-totalite des environnements de developpement. Si vous debutez avec les machines virtuelles et les environnements Linux, notre guide sur l’installation de Linux Mint en machine virtuelle avec KVM peut vous aider a configurer un environnement de test ideal.

2.2 Methodes d’installation

Gemini CLI offre plusieurs methodes d’installation, ce qui permet a chaque utilisateur de choisir celle qui correspond le mieux a son flux de travail. Voici les differentes options disponibles, de la plus courante a la plus specialisee :

2.3 Premier lancement et authentification

Une fois Gemini CLI installe via npm, le premier lancement se fait simplement en tapant la commande gemini dans votre terminal. L’outil vous guidera automatiquement a travers un processus d’authentification OAuth via votre navigateur web. C’est la methode la plus simple et elle ne necessite aucune configuration prealable. Pour les environnements headless (serveurs, CI/CD), vous pouvez utiliser une cle API Gemini en definissant la variable d’environnement GEMINI_API_KEY, ou bien configurer Vertex AI avec un compte de service Google Cloud. Pour les utilisateurs avances souhaitant deployer des modeles localement, notre guide sur l’installation d’un LLM en local (Llama 4 / Mistral) presente des approches complementaires.

Exemple d’authentification avec cle API :

# Exporter la cle API Gemini

export GEMINI_API_KEY=votre_cle_api_ici

# Ou utiliser Vertex AI

export GOOGLE_GENAI_USE_VERTEXAI=true

export GOOGLE_CLOUD_PROJECT=mon-projet-gcp

export GOOGLE_CLOUD_LOCATION=us-central1

# Puis lancer Gemini CLI

geminiApres authentification, vous pouvez verifier votre configuration et vos quotas en utilisant la commande /stats model directement dans l’interface interactive de Gemini CLI. Cette commande affiche le nombre de tokens utilises dans la session en cours, les limites de quota restantes et le modele actif. C’est un excellent moyen de s’assurer que tout fonctionne correctement avant de plonger dans l’utilisation quotidienne de l’outil.

Les commandes essentielles de Gemini CLI

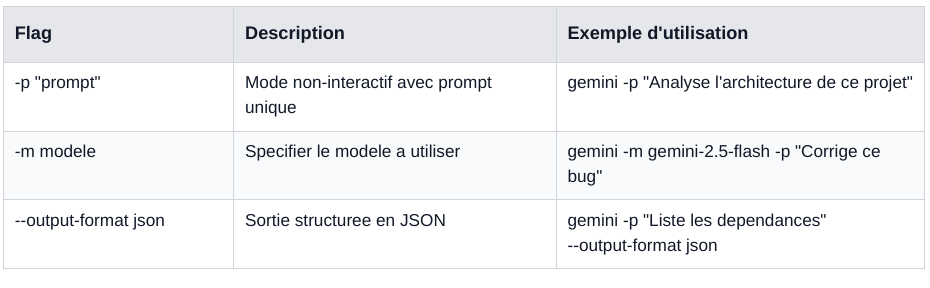

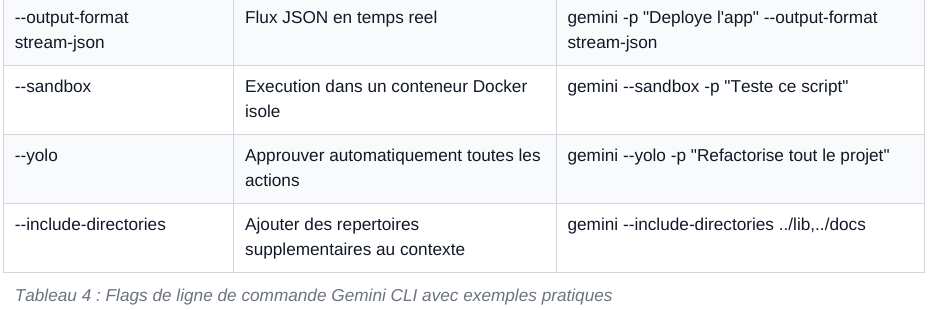

3.1 Options de ligne de commande (CLI Flags)

Gemini CLI offre un ensemble d’options de ligne de commande qui permettent de controler finement son comportement, notamment dans les contextes de scriptage et d’automatisation. Ces flags transforment radicalement l’outil, le faisant passer d’un assistant interactif a un veritable composant d’infrastructure capable de s’integrer dans des pipelines CI/CD, des scripts d’administration systeme ou des workflows de deploiement automatises.

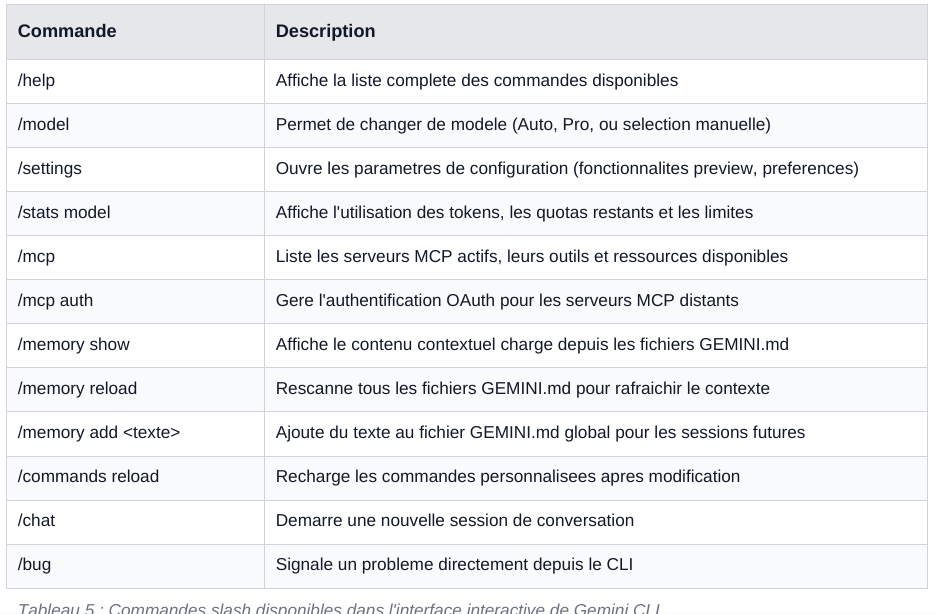

3.2 Commandes slash (/)

Les commandes slash constituent le coeur de l’interaction avec Gemini CLI en mode interactif. Elles permettent de gerer la session, de changer de modele, de consulter les statistiques, de gerer les serveurs MCP et bien plus encore. Voici les commandes les plus utilisees au quotidien par les developpeurs :

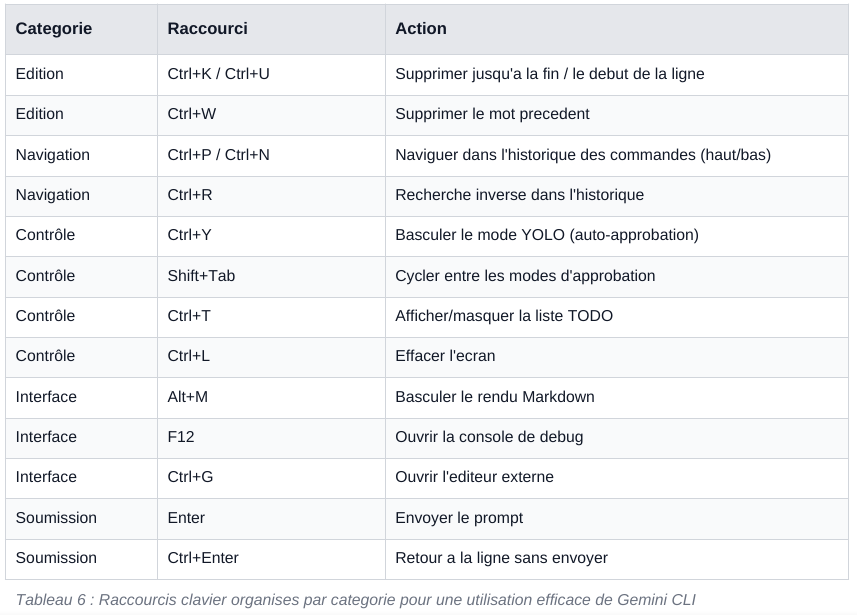

3.3 Raccourcis clavier

La maitrise des raccourcis clavier est essentielle pour tirer le meilleur parti de Gemini CLI et gagner en productivite. L’outil propose un ensemble complet de raccourcis couvrant l’edition de texte, la navigation dans l’historique, et le controle de l’interface. Parmi les plus utiles pour le travail quotidien, on retrouve Ctrl+Y pour basculer en mode YOLO (approbation automatique de toutes les actions),

Shift+Tab pour cycler entre les modes d’approbation, Ctrl+T pour afficher la liste TODO, et Alt+M pour basculer le rendu Markdown. La touche F12 ouvre la console de debug, tandis que Ctrl+G lance un editeur externe pour la redaction de prompts complexes.

Configuration avancee

4.1 Architecture de la configuration

La configuration de Gemini CLI repose sur un systeme multicouche sophistique qui permet un controle fin a differents niveaux de granularite. Les parametres sont appliques dans l’ordre de precedence suivant : les valeurs par defaut codees dans l’application sont les premieres, puis les parametres systeme (/etc/gemini-cli/system-defaults.json), ensuite les parametres utilisateur (~/.gemini/settings.json), les parametres projet (.gemini/settings.json a la racine du projet), les surcharges systeme, les variables d’environnement, et enfin les arguments de ligne de commande qui ont la priorite la plus elevee. Cette architecture permet par exemple de definir des regles globales pour tous vos projets tout en permettant des specificites par projet.

4.2 Le fichier GEMINI.md : votre memoire de projet

Le systeme GEMINI.md est l’une des fonctionnalites les plus puissantes de Gemini CLI. Il s’agit de fichiers Markdown que l’IA charge automatiquement comme contexte pour chaque session. Vous pouvez placer un fichier GEMINI.md a la racine de votre projet pour fournir des instructions persistantes a l’IA : conventions de codage, structure du projet, dependances, preferences d’equipe, et toute autre information pertinente. Un fichier GEMINI.md global (~/.gemini/GEMINI.md) s’applique a tous vos projets, tandis que les fichiers JIT (Just-in-Time) sont automatiquement detectes dans des repertoires specifiques lorsque des fichiers sont accessibles.

# Exemple de fichier GEMINI.md a la racine du projet

## Conventions de code

- Langage : TypeScript avec mode strict

- Framework : Next.js 15 avec App Router

- Style : ESLint + Prettier, double quotes

- Tests : Vitest avec coverage minimum 80%

## Structure du projet

- /src/app : Routes de l'application

- /src/components : Composants React reutilisables

- /src/lib : Utilitaires et fonctions auxiliaires

- /prisma : Schema de base de donnees

## Import de contexte supplementaire

@./docs/architecture.md

@./docs/api-reference.mdLa syntaxe d’import avec le symbole @ permet de modulariser votre contexte en important d’autres fichiers Markdown. Cela vous permet de garder votre GEMINI.md principal concis tout en fournissant a l’IA un contexte riche et detaille sur votre projet. Les commandes /memory show, /memory reload et /memory add vous permettent de gerer ce contexte en temps reel sans quitter la session.

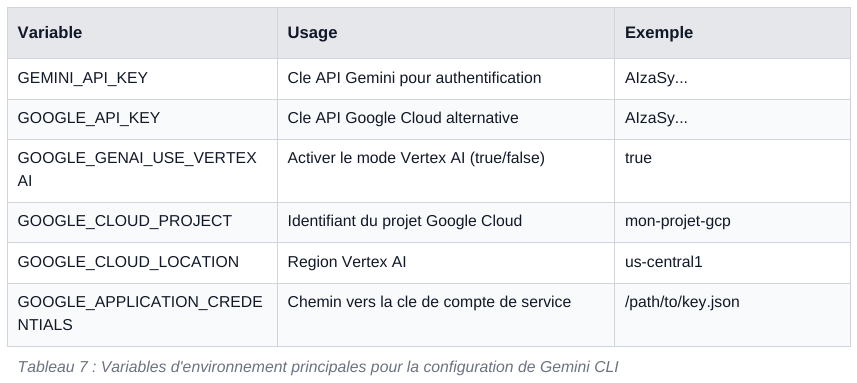

4.3 Variables d’environnement et fichiers .env

Gemini CLI supporte les fichiers .env pour une configuration flexible et securisee. Vous pouvez placer un fichier .env dans le repertoire .gemini/ de votre projet ou dans votre repertoire personnel (~/.gemini/.env). Les variables chargees proviennent du premier fichier trouve (pas de fusion). Les variables d’environnement principales incluent GEMINI_API_KEY pour l’authentification par cle API, GOOGLE_GENAI_USE_VERTEXAI pour activer le mode Vertex AI, et GOOGLE_CLOUD_PROJECT pour specifier le projet GCP. Il est crucial de ne jamais commiter vos fichiers .env dans votre depot Git pour des raisons de securite.

5 Protocole MCP : etendez les capacites de Gemini CLI

5.1 Qu’est-ce que le Model Context Protocol ?

Le Model Context Protocol (MCP) est un protocole ouvert developpe par Anthropic et adopte par Google qui sert de pont entre les modeles d’IA et les systemes externes. Dans le contexte de Gemini CLI, les serveurs MCP exposent des outils (fonctions appelables), des ressources (donnees lisibles) et des prompts a l’agent IA. Concretement, cela signifie que vous pouvez connecter Gemini CLI a une base de donnees PostgreSQL, a l’API GitHub, a Firebase, a Google Workspace, ou a n’importe quel service via un serveur MCP personnalise. Cette architecture modulaire transforme Gemini CLI d’un simple assistant en une plateforme d’automatisation complete.

L’integration de MCP dans Gemini CLI supporte trois mecanismes de transport : Stdio (communication via processus fils), SSE (Server-Sent Events pour les serveurs distants), et Streamable HTTP (streaming HTTP pour les connexions temps reel). La configuration se fait dans le fichier settings.json sous la cle mcpServers, avec des options de securite avancees comme l’auto-redaction des variables sensibles, le filtrage des outils par liste blanche/noire, et l’authentification OAuth pour les serveurs distants. Pour explorer d’autres outils d’automatisation IA open source, notre guide complet sur n8n en 2026 presente une alternative puissante pour l’automatisation de workflows.

5.2 Configuration d’un serveur MCP

# Configuration MCP dans .gemini/settings.json

{

"mcpServers": {

"github": {

"command": "npx",

"args": ["-y", "@modelcontextprotocol/server-github"],

"env": { "GITHUB_TOKEN": "$MY_GITHUB_TOKEN" }

},

"firebase": {

"command": "npx",

"args": ["-y", "@anthropic-ai/mcp-server-firebase"]

},

"postgres": {

"command": "npx",

"args": ["-y", "@modelcontextprotocol/server-postgres",

"postgresql://..."],

"timeout": 30000

}

}

}Une fois les serveurs MCP configures, la commande /mcp dans l’interface interactive affiche la liste de tous les serveurs actifs, leurs outils disponibles et les ressources accessibles. Vous pouvez egalement utiliser /mcp auth pour gerer l’authentification OAuth des serveurs distants. Les outils MCP sont accessibles via leur nom complet (mcp_nomServeur_nomOutil) et le systeme de securite redacte automatiquement les variables d’environnement sensibles (contenant TOKEN, SECRET, PASSWORD, KEY ou AUTH) avant de les ransmettre aux processus des serveurs MCP, assurant ainsi une protection robuste de vos informations d’identification.

6 Deploiement et automation avec Gemini CLI

6.1 Deploiement sur Google Cloud Run

L’une des integrations les plus puissantes de Gemini CLI est sa capacite a deployer des applications directement sur Google Cloud Run grace a une extension officielle. Cette fonctionnalite transforme le terminal en une plateforme de deploiement complete, ou vous pouvez decrire votre application en langage naturel et laisser l’IA gerer l’ensemble du processus de deploiement. L’extension Cloud Run

est implementee sous forme de serveur MCP et necessite Gemini CLI version 0.4.0 ou superieure. Le deploiement se fait en trois etapes : installation de l’extension, authentification Google Cloud, puis execution de la commande /deploy directement dans l’interface.

Workflow de deploiement Cloud Run :

# Etape 1 : Installer l'extension Cloud Run

gemini extensions install cloud-run

# Etape 2 : Authentifier avec Google Cloud

gcloud auth application-default login

# Etape 3 : Lancer Gemini CLI et deployer

gemini

> /deploy mon-application-sur-cloud-runL’extension Cloud Run ne se contente pas d’un simple deploiement : elle peut analyser votre code, generer le Dockerfile necessaire, configurer les variables d’environnement, definir les regles de securite et meme optimiser les couts en recommandant la configuration de ressources adaptee. Cette approche par l’IA du deploiement represente un gain de temps considerable pour les equipes DevOps, eliminant la necessite d’ecrire et de maintenir manuellement des fichiers de configuration complexes. Pour les professionnels souhaitant se former aux outils modernes de developpement, notre page de guides pour bien demarrer sur AngleFormation propose des ressources

complementaires.

6.2 Mode headless et scripting

Le mode headless de Gemini CLI ouvre la porte a l’automatisation complete. En utilisant le flag -p avec un prompt et l’option –output-format, vous pouvez integrer Gemini CLI dans des scripts shell, des pipelines CI/CD et des workflows d’integration continue. Le format JSON permet de parser programmatiquement les reponses, tandis que le format stream-json offre un flux en temps reel des evenements, ideal pour les interfaces de monitoring et les dashboards d’automatisation.

Exemples d’automation en mode headless :

# Generer une revue de code au format JSON

gemini -p "Revoyez les changements dans le dernier commit et identifiez les bugs"

\

--output-format json > review.json

# Analyser un projet et generer un rapport

gemini -p "Analyse la structure de ce projet et suggere des ameliorations" \

--output-format text > rapport-analyse.txt

# Mode streaming pour pipelines CI/CD

gemini -p "Execute les tests, identifie les echecs et propose des corrections" \

--output-format stream-json | process-pipeline.sh6.3 Integration GitHub Actions

Google propose une action GitHub officielle (google-github-actions/run-gemini-cli) qui permet d’utiliser Gemini CLI directement dans vos workflows GitHub Actions. Cette integration ouvre des possibilites d’automatisation avancees pour les equipes de developpement : revues de code automatiques lors de chaque pull request, triage intelligent des issues, assistance a la demande via la mention @gemini-cli, et memes workflows planifies pour des analyses regulieres. L’authentification se fait via un compte de service Vertex AI stocke dans les secrets GitHub, assurant un fonctionnement entierement automatique et securise. Pour les equipes utilisant des plateformes comme n8n pour l’automatisation, l’association de Gemini CLI avec n8n via des serveurs MCP personnalises cree une chaine d’automatisation extremement puissante. Imaginez un workflow ou Gemini CLI analyse automatiquement les nouveaux tickets, genere des correctifs, les teste, et les deploie, le tout sans intervention humaine. Pour decouvrir comment combiner ces outils, consultez notre guide complet sur n8n en 2026 : l’automatisation IA open source.

7 Bonnes pratiques et astuces avancees

7.1 Optimiser l’utilisation du contexte

Avec une fenetre de contexte d’un million de tokens, Gemini CLI offre une capacite de traitement considerable. Cependant, il est essentiel de bien gerer cet espace pour des performances optimales. Le seuil de compression par defaut est fixe a 50 % du contexte utilise, ce qui signifie que lorsque la moitie de la fenetre est remplie, Gemini CLI commence a compresser automatiquement les echanges precedents pour maintenir de l’espace disponible. Vous pouvez ajuster ce seuil dans settings.json via la cle model.compressionThreshold. L’utilisation judicieuse des fichiers GEMINI.md permet de fournir un contexte riche sans consommer l’espace de conversation, tandis que les commandes personnalisees (TOML) permettent de creer des raccourcis pour les prompts recurrents, economisant ainsi des tokens et du temps.

7.2 Securite et bonnes pratiques

La securite est un aspect fondamental de l’utilisation de Gemini CLI, particulierement dans les environnements d’entreprise. Plusieurs mecanismes sont integres pour proteger vos donnees et vos systemes. Le mode sandbox Docker isole l’execution des commandes shell dans un conteneur, empechant toute modification non autorisee de votre systeme. Le systeme d’approbation multiniveau

(default, auto_edit, plan, yolo) vous permet de controler finement le niveau d’autonomie accorde a l’IA. Les variables sensibles dans les configurations MCP sont automatiquement redactees, et le fichier .geminiignore (similaire au .gitignore) vous permet d’exclure des fichiers ou repertoires du contexte accessible a l’IA. Il est egalement recommande de desactiver les statistiques d’utilisation (privacy.usageStatisticsEnabled: false) si vous travaillez sur des projets sensibles.

7.3 Commandes personnalisees

Les commandes personnalisees sont des fichiers TOML stockes dans ~/.gemini/commands/ (global) ou .gemini/commands/ (projet) qui vous permettent de creer des raccourcis puissants pour les taches repetitives. Chaque commande peut inclure des arguments dynamiques (via {{args}}), executer des commandes shell et injecter leurs resultats (via !{command}), ou inserer le contenu de fichiers (via @{path}). Le support de l’espace de noms permet d’organiser vos commandes logiquement : par exemple, un fichier git/commit.toml sera accessible via /git:commit dans l’interface interactive.

# Exemple : .gemini/commands/review.toml

prompt = """Revoyez le code dans {{args}} et fournissez :

1. Les bugs potentiels

2. Les ameliorations de performance

3. Les violations de bonnes pratiques

Basez-vous sur les conventions definies dans GEMINI.md"""

# Exemple : .gemini/commands/deploy-check.toml

description = "Verification pre-deploiement complete"

prompt = """Executez les verifications suivantes avant le deploiement :

- Lancez !{npm run lint} et analysez les resultats

- Lancez !{npm run test} et verifiez la couverture

- Verifiez que @{CHANGELOG.md} est a jour

- Generez un rapport de readiness"""8 Gemini CLI et l’avenir de l’IA en ligne de commande

L’emergence de Gemini CLI s’inscrit dans une tendance plus large de democratisation de l’IA dans les outils de developpement. Alors que Google SGE transforme la recherche web et le referencement naturel, les outils d’IA en ligne de commande redessinent les workflows de developpement. Gemini CLI represente un veritable changement de paradigme : plutot que de copier-coller du code depuis

une interface web, le developpeur interagit avec l’IA dans son environnement naturel, avec un contexte enrichi par les fichiers du projet, les outils systeme et les services cloud. Cette approche context-aware est fondamentalement plus productive et plus pertinente que les assistants generiques. Pour comprendre comment l’IA redistribue les cartes du SEO et de la visibilite en ligne, notre analyse du SGE 2026 et de l’avenir de l’affiliation offre un eclairage complet sur ces mutations.

Pour les professionnels du marketing digital et les createurs de contenu, Gemini CLI offre egalement des possibilites inedites. Sa capacite a analyser des documents, a generer du contenu structure et a effectuer des recherches web en temps reel en fait un outil precieux pour l’optimisation SEO, la creation de landing pages et la strategie de contenu. Associe a des outils d’automatisation comme

n8n, il permet de mettre en place des pipelines de contenu entierement automatises, de la recherche de mots-cles a la publication. Si vous etes interesse par la creation de pages de conversion optimisees par l’IA, notre guide sur les landing pages avec IA presente les meilleures strategies et outils disponibles.

En conclusion, Gemini CLI s’impose en 2026 comme un outil incontournable pour tout professionnel souhaitant tirer parti de l’IA generative dans son quotidien. Sa combinaison unique de modele puissant (Gemini 3), de forfait gratuit genereux (1 000 requetes/jour), d’integration systeme profonde (shell, fichiers, web) et d’extensibilite via MCP en fait une solution complete et scalable. Que vous

soyez developpeur, DevOps, architecte logiciel ou professionnel du marketing, Gemini CLI merite une place dans votre boite a outils. Son ecosysteme grandit rapidement, avec de nouvelles extensions, serveurs MCP et integrations qui apparaissent chaque semaine. Le futur de l’IA est dans votre terminal, et il est deja la.

Liens utiles et articles complementaires

Pour aller plus loin dans votre maitrise de l’IA et des outils de productivite, nous vous recommandons

les articles suivants publies sur AngleFormation :

- Intelligence Artificielle en Entreprise – Comprendre les enjeux strategiques de l’IA pour les

organisations - Installer un LLM en Local (Llama 4 / Mistral) – Guide pour deployer des modeles IA localement

- n8n en 2026 : Le Guide de l’Automatisation IA Open Source – Maitriser l’automatisation avec n8n